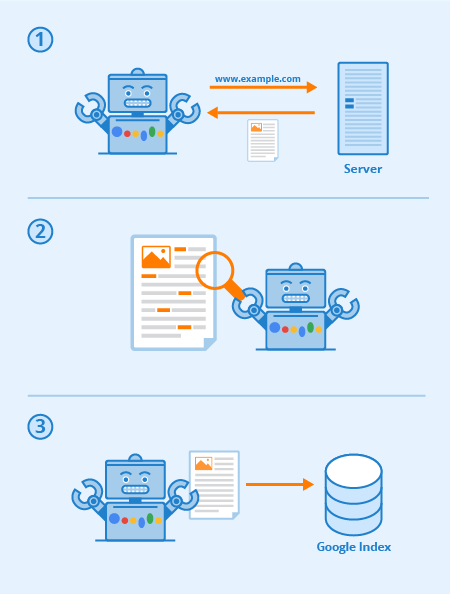

গতদিন জেনেছিলাম একটা Term. “Crawl Budget“, “Crawl Issue“.

আজকে একটু Detail জানবো এটা কিভাবে আমাদের সাইট এ প্রভাব ফেলে।

Crawl Rate Limit:

GoogleBot আপনার সাইট প্রতিবার crawl করার আগে কতক্ষণ অপেক্ষা করে তার লিমিট। Example: ১ সেকেন্ড এ ৫ টা request হয়।

Technically আপনি Googlebot limit increase or decrease করতে পারেন। কিন্তু যদি bot বেশি request করে ফেলে, আপনার সার্ভার এ request বেড়ে গেলে সাইট স্লো হয়ে যাবে।

তাই Natural রাখায় ভালো।

Crawl Health:

আপনার সার্ভার googlebot কে যত ফাস্ট response করবে, bot আপনার সাইট কে ততো healthy মনে করবে এবং rate automatic বাড়বে। আর দেরিতে করলে কমবে।

Crawl Demand:

যদি আপনি আপনার সাইট এ আর্টিকেল না দেন, অথবা অনেক গ্যাপ দেন, অথবা Internal Link করা না হয়, তাহলে Crawl Demand Reduce হবে।

**আপনার সাইট এর যে যে পেইজ গুলো ভালো ট্রাফিক পাবে, ওই পেইজ bot বার বার Crawl করবে। Freshness ধরে রাখার জন্য। আমি বুঝাতে চাচ্ছি, কোন নতুন আপডেট আসলো নাকি। আর যেগুলো less value provide করে, ওগুলোর crawl rate কমে যাবে।

তাই আমাদের আর্টিকেল এমন দিতে হবে যাতে overall site strong হয়।

আর যাদের লেস ট্রাফিক পেইজ আছে তারা কিভাবে কি কি maintain করে ওগুলো delete করবেন তা পরের আর্টিকেল এ আলোচনা করবো।

কারন, আপনার সাইট এর প্রতিটা পেইজ কোন না কোন value add করে আপনার সাইট এর জন্য। তাই কোন পেইজ না জেনে বাদ দিয়ে দিলে হিতে-বিপরীত হতে পারে।

আজকের জন্য এটুকু, আমি কম কম আলোচনা করি, যাতে যতটুকু পরবেন তা যেন বুঝেন এবং মনে থাকে।

রচনা লিখে জগাখিচুরি পাকানোর ইচ্ছে নেই।

**Tips:

আপনার website এর sitemap, নিচে মানে footer এ অ্যাড করে রাখবেন। আমরা অনেকে webmaster এ sitemap add করতে ভুলে যাই। অথবা, আমাদের plugin rank math/yoast sitemap দেড়িতে submit করে।

তাই, যখন আপনি sitemap footer এ অ্যাড করে রাখবেন, googlebot crawl করতে আসলে sitemap দেখবে এবং নিউ কোন পোস্ট থাকলে তা পেয়ে যাবে।

আমি personally উপকার পেয়েছি।

For English Audience

Crawl Rate Limit:

Limit how long GoogleBot waits before crawling your site each time. Example: 5 requests are made in 1 second.

Technically you can increase or decrease the Googlebot limit. But if the bot makes more requests, the site will slow down if the request increases on your server. So it is better to keep it natural.

CRAWL HEALTH:

The faster your server responds to Googlebot, the healthier the bot will think your site is and the rate will automatically increase. And if you do it late, it will decrease.

CRAWL DEMAND:

If you do not provide articles on your site, or many gaps, or internal links are not made, then the crawl demand will reduce.

** The pages of your site which will get good traffic, the bot will crawl that page again and again. To retain freshness. I mean, is there any new update? And those that provide less value, their crawl rate will decrease.

So we have to give articles in such a way that the overall site is strong.

And those who have fewer traffic pages, and how to maintain and delete them, I will discuss in the next article.

Because every page of your site adds some value to the site. So if you exclude any page without knowing it can be counterproductive.

That’s it for today, I discuss it a little bit so that you understand and remember what you wear.

I don’t want to make a mess by writing essays.

**Tips:

Add the sitemap of your website to the footer below. Many of us forget to add sitemap to webmaster.

Or, our plugin submits the rank math/yoast sitemap in delay. So, when you add the sitemap to the footer, googlebot will actually look at the sitemap to crawl and if there is any new post, it will get it. I have personally benefited.